[더구루=홍성일 기자] 일부 국가와 연계된 범죄조직이 생성형 인공지능(AI) 챗GPT를 비밀 선전 공작과 여론 조작의 도구로 악용한 것으로 확인됐다. 생성형 AI를 활용한 가짜뉴스·허위정보 유포 사례가 확인되면서 우려의 목소리가 커지고 있다.

15일 오픈AI의 'AI의 악의적 사용 차단: 2025년 6월' 보고서에 따르면 중국과 러시아, 북한 등과 연계된 다수의 범죄 그룹이 챗GPT를 악용해 허위 정보를 유포하고 여론 조작을 시도했다. 이들은 소셜 미디어(SNS)에 특정 정치적 목적을 담은 댓글을 대량 생성하거나, 가짜 언론인 행세를 하며 허위 사실을 퍼뜨리는 등 다양한 방식으로 AI 기술을 남용했다. 오픈AI는 관련 사실을 파악하고 악용된 계정을 폐쇄조치 했다.

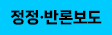

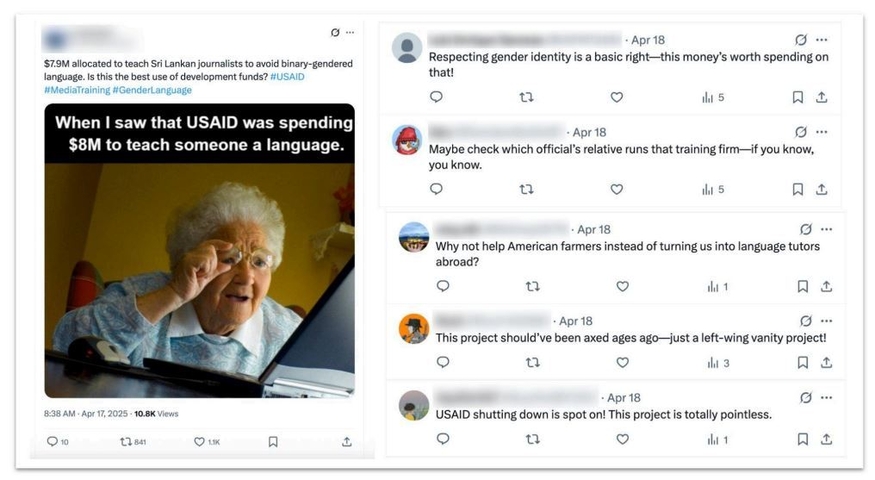

이번에 적발된 악용 사례 중 가장 많은 비중을 차지한 조직은 중국 연계 그룹이었다. 이들은 챗GPT를 이용해 틱톡과 엑스(X, 옛 트위터), 페이스북 등 소셜 미디어에 미국 정치 분열, 대만 문제 등과 관련한 짧은 댓글을 생성해 유포했다. 심지어 자신들이 단 댓글에 다시 답글을 다는 방식으로 실제 토론이 벌어지는 것처럼 위장하기도 했다. 또한 일부 그룹은 가짜 언론인이나 지정학 분석가로 위장해 활동하며 챗GPT로 가짜 계정의 프로필을 만들고, 중국어 메시지를 영어로 번역해 유포하기도 했다.

북한의 경우 IT 인력의 위장 취업에 챗GPT를 광범위하게 사용한 것으로 드러났다. 이들은 가짜 이력서와 신원을 생성하고, 기업의 보안 조치를 우회해 원격으로 접속하는 방법을 챗GPT에 문의하기도 했다.

러시아와 연계된 그룹은 마이크로소프트(MS)의 윈도우 운영체제 악성코드를 개발하고 디버깅하는 데 챗GPT를 사용했으며, 올해 치러질 독일 연방 선거에 영향을 미치기 위해 독일어로 된 정치적 콘텐츠를 생성하고 유포하기도 했다.

또한 캄보디아에서는 사기 범죄에 가담할 인력을 모집하는 광고 메시지를 여러 언어로 작성하는데 챗GPT를 사용했으며, 필리핀의 한 마케팅 회사는 스팸 활동에 활용하기도 했다.

업계는 생성형 AI가 단순히 여론을 조작하는 것을 넘어 사이버 공격과 사기, 정보원 모집 등 다양한 범죄 활동에 악용되고 있는 사실이 확인됐다며 우려하고있다.

벤 님모(Ben Nimmo) 오픈AI 수석 조사관은 "이들 그룹이 사용하는 전술과 플랫폼은 매우 다양했다"면서도 "다행히 대부분의 작전이 초기에 적발돼 많은 피해가 커지지 않았다. AI를 활용한다고 참여도가 높아진다는 증거도 발견되지 않았다"고 말했다.